1 算法简介

XGBoost全称为eXtreme Gradient Boosting,是一种基于梯度提升决策树(Gradient Boosting Decision Tree)的集成学习算法。它在GBDT的基础上进行了改进,引入了正则化项和二阶导数信息,提高了模型的性能和泛化能力。

2 算法原理

XGBoost模型的核心思想是将多个弱分类器(决策树)组合成一个强分类器。每个决策树都在前一棵树的残差基础上进行训练,通过不断迭代优化损失函数来逐步减小残差。同时,模型通过控制树的复杂度和正则化项来减少过拟合风险。

XGBoost的原理基于梯度提升算法,它通过迭代地添加预测树,每棵树都尝试纠正前一棵树的错误。XGBoost的关键特点包括:

(1)二阶泰勒展开:XGBoost在损失函数的优化中使用了二阶泰勒展开,这使得算法在处理非线性问题时更加精确。

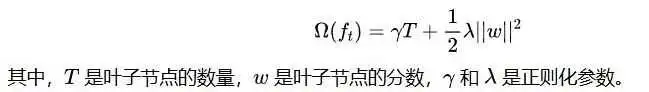

(2)正则化:为了防止过拟合,XGBoost在目标函数中加入了正则项,控制模型的复杂度。

(3)缺失值处理:XGBoost能够自动处理数据中的缺失值,通过学习最优的分裂点来处理缺失数据。

(4)并行化:XGBoost支持特征维度的并行处理,提高了算法的训练效率。

(1)数据预处理:首先,需要对原始数据进行清洗和预处理。这包括处理缺失值、处理异常值、特征选择、数据标准化等操作。

(2)划分训练集和测试集:为了评估模型的性能,需要将数据集划分为训练集和测试集。通常,80%的数据用于训练,20%的数据用于测试。

(3)参数调优:XGBoost模型中有许多参数可以调整,如学习率、树的数量、树的深度等。通过交叉验证和网格搜索等技术,可以找到最优的参数组合。

(4)训练模型:使用训练集进行模型训练。XGBoost模型会根据损失函数的定义逐步优化分类器,生成多个决策树模型。

(5)模型评估:使用测试集对训练好的模型进行评估。常见的评估指标包括准确率、精确率、召回率、F1值等。

3 算法应用

XGBoost在多个领域都有广泛的应用,包括金融风控(信用卡欺诈检测、信贷审批)、推荐系统(商品推荐、新闻推荐)、生物医学(基因表达数据分析、疾病诊断中构建精确的模型),等等。在中医药领域,XGBoost常被用于复发预测研究,郝若飞等学者针对缺血性脑卒中患者中医药治疗的复发构建了XGBoost模型预测研究,同时构建逻辑回归模型(LR)、线性二分类模型(SVM)、指数布朗运动模型(GBM)、决策树算法模型(DT)、随机森林算法模型(RF)六种模型。研究纳入2019年3月至2022年6月北京中医药大学附属护国寺中医医院缺血性脑卒中患者48例,分为复发组和未复发组,比较两组患者各项指标差异,分别构建复发风险预测模型,加入组间差异P<0.1的变量作为风险变量,将病例样本按7:3随机分组分为训练集和测试集,用于模型的训练和验证。根据预测假阳性率、假阴性率、总体正确率,根据预测结果绘制ROC曲线,计算AUC值,敏感度,特异度,筛选出预测性能最好的模型。

4 小结

推荐阅读:

CLIP模型:构建视觉与语言的通用表示

提示学习:让语言模型在低资源场景下保持良好表现的新工具

掩码语言模型:构建下一代智能语言处理系统的关键技术

版权声明:

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若内容造成侵权、违法违规、事实不符,请将相关资料发送至xkadmin@xkablog.com进行投诉反馈,一经查实,立即处理!

转载请注明出处,原文链接:https://www.xkablog.com/jszy-jnts/61127.html